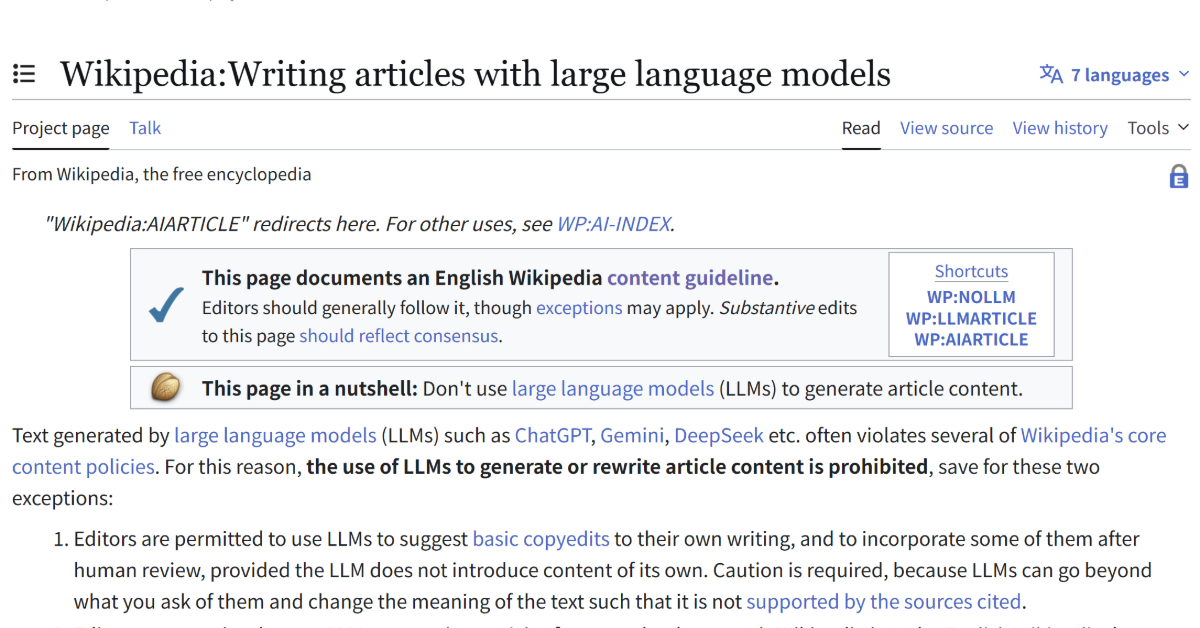

2026年3月27日、Wikipediaが大規模言語モデル(LLM)による記事生成を原則禁止すると発表しました。これにより、LLMの活用がどのように変化するのか、多くの人が気になっていると思います。特に、情報の正確性や信頼性を維持するための対策として、この決定は注目されています。この記事では、Wikipediaの動きの背景やその影響について考察してみることにします。

Wikipediaの基本方針と今回の決定

まず、Wikipediaは誰でも編集できる自由な百科事典です。これに対して、LLMは自動で文章を生成する技術です。Wikipediaは、信頼できる情報を提供するために、主に人間による編集を重視しています。この背景から、LLMによる自動生成を禁止することになったのです。

LLMの仕組みとリスク

LLMは膨大なデータを学習し、自然な言語で文章を生成しますよね。しかし、生成された情報が必ず正確であるとは限りません。例えば、仮にLLMが誤ったデータを基に記事を生成した場合、利用者はそれを真実と受け取る危険があるのです。これがWikipediaが自動生成を禁止する主な理由なんです。

もし異なる条件下での運用があったら

例えば、もしWikipediaがLLMを活用して内容を補完する形で運用していたとしたら、どのような結果になったでしょう。人間が生成した内容を基に、LLMが補足情報を提供することで、記事の質が向上する可能性もあります。しかし、その際に情報の正確性が担保されるかどうかは別の問題です。

現場での利用を考えるとどうなるのか

実務的には、Wikipediaの情報を引用する際に、LLMの生成コンテンツをどのように扱うかが鍵になります。例えば、情報の裏取りをしっかり行うことで、信頼性を高めたり、LLMの生成する情報はあくまで参考として扱うことが重要です。これにより、誤情報を避けることが可能になるのです。

次に確認すべきことは、実際にどのような方法で信頼性の高い情報を確保するかです。例えば、他の信頼できる情報源を参照することや、複数の専門家の意見を集めることが考えられます。

元記事のタイトルは「Wikipedia、LLMによる記事生成を原則禁止に」で、URLはこちらです。